損失関数

このタグの解説について

この解説文は、すでに終了したサービス「はてなキーワード」内で有志のユーザーが作成・編集した内容に基づいています。その正確性や網羅性をはてなが保証するものではありません。問題のある記述を発見した場合には、お問い合わせフォームよりご連絡ください。関連ブログ

ネットで話題

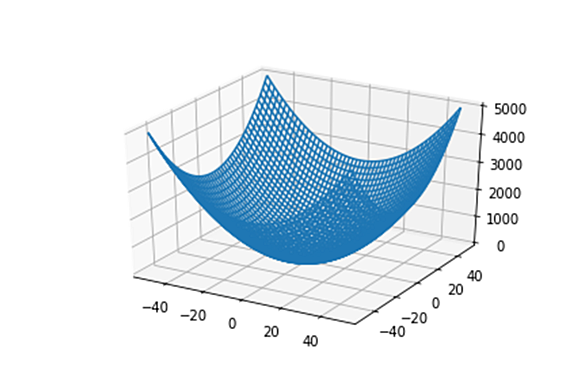

もっと見る13ブックマーク損失関数はそれほど複雑な関数ではないのかも?と言う話 - Obey Your MATHEMATICS.前回の記事 mathetake.hatenablog.com にある論文(2-2-9)[1605.07110] Deep Learning without Poor Local Minimaについてのお話です*1。 Abstractを読んだ瞬間に、こんな重要な論文をどうして今まで知らなかったのかと言うぐらい興奮しました。 少し長いですが引用しますと In this paper, we prove a conjecture publis... mathetake.hatenablog.com

mathetake.hatenablog.com