強化学習

(サイエンス)

【きょうかがくしゅう】

(英) Reinforcement Learning の訳語。

試行錯誤に基づく教師なし機械学習の一種。心理学における条件付けと考えると分かりやすい。

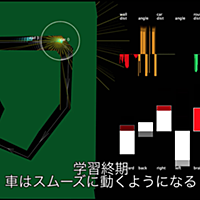

学習するエージェントは、あるタスクを達成するために行動する。その中で、環境から随時、報酬(あめとむち)を受け取る。エージェントはこの報酬の合計を最も多くもらえるように行動の価値を更新していく。最終的に、エージェントは報酬の合計が最も多くもらえる、すなわちタスクを達成できる行動が何かを学習する。

状態の価値を表す状態価値関数、もしくは、状態と行動の組み合わせの価値を表す行動価値関数を学習し、関数の値が最大となる行動をグリーディーに選択していく。報酬自体は、ゴールに着いたときなど、ある特定のタイミングでしかもらえないが、状態価値関数や行動価値関数では、その時点以降、累計してどれくらいの報酬がもらえるかという期待値に基づいて関数の値を決める。そのため、状態価値関数や行動価値関数に基づいてグリーディーに行動しても、合計報酬を最大化した行動になる。

強化学習の学習アルゴリズムの一つであるTD学習は、古典的な人工知能での全解探査法である動的計画法とシミュレーション計算手法で有名なモンテカルロ法の特徴をあわせ持つ。

状態価値関数や行動価値関数は、全ての状態・行動の組み合わせを離散的に表で管理することもできるが、線形基底関数モデルや非線形モデル(ニューラルネットワークなど)に基づいて、連続関数として表現することもできる。

TD学習は、方策空間内の最急降下法と似た学習方法であり、最大解ではなく、収束しても、局所解に収束する。そのため、方策空間の最大解を直接探索し、最適化問題を解く方法もある。

代表的な強化学習の学習手法には

などがある。

応用例としては

- ゲームAI(バックギャモン)

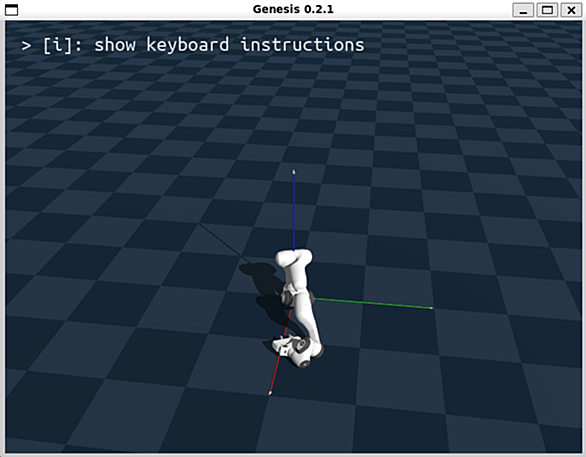

- ロボットの行動制御(ロボサッカーや2足歩行制御など)

- タスクスケジューリング

- チャンネル割り当て

など。